图片来源:Markus Spiske on Unsplash

图片来源:Markus Spiske on Unsplash

不久前,一个德国的华裔程序员宣称自己已经开发出一款应用程序。该程序通过应用人脸识别技术,与各大社交媒体上发布的照片进行反复核对,从而能够识别出网络淫秽作品中出现的女性。

此言论一经发布,便在微博上引起了轩然大波,评论区的网友们也欢呼雀跃起来。不久后,耶鲁大学法学院蔡中曾中国中心的一位名叫Yiqin Fu的助理研究员又将这一消息发布到了推特上,并且翻译成英文,让全世界的人都知道这个消息。具体内容如下:

一个目前生活在德国的华裔程序员说,他和朋友通过对成人视频和社交媒体中个人资料照片进行交叉引用,最后在世界范围内成功地识别出十万余名AV女演员。开发该程序的目的在于帮助人们核实他们的女朋友是否出演过成人影片。

根据原微博中的评论,他们从Pornhud和xVideos等成人视频网站收集了100多TB的视频数据后,将这些数据与Facebook、Instagram、抖音、微博等社交媒体上的照片进行反复对比,最后确认了10万多个色情演员的身份。

实际上,没有人真正见过这个应用程序,并且开发者的身份也一直是个谜。尽管他声称自己叫Li Xu,但其真实性并未得到证实。不过,这一新闻仍然在坊间流传着,毕竟,它是有关于色情业的。

图片来源:截屏自 Yiqin Fu on Twitter

图片来源:截屏自 Yiqin Fu on Twitter

Li Xu进一步证实道,他计划在微博上发布与该程序相关的数据库模式和一些技术细节。然而,这一计划最终也未能付诸于实践,因为他取消了当时的直播计划,本来他打算通过这场直播来回答媒体的问题。除此之外,他还把整个项目连同所有数据全部删除了。他之所以这样做,与其说是在反思后做出了更加明智的判断,倒不如说是网络舆论的结果。

在社交媒体上,大家对于这一事件也讨论得热火朝天。然而大部分人在评论时关注的却是这些问题:真的做出了这个应用程序吗?它的效果好吗?这个团队做这个程序时看了多少A片啊?他们自己有女朋友吗?显而易见,这些言论都偏离了这一事件的重点。我们应该探讨的是将人脸识别程序应用到色情业到底会带来哪些危害,并且我希望每个人都能明白这一点。

只不过是“冰山一角”

实际上,想开发出这样一款应用程序也不是不可能的。然而,还是有很多人追问到底有没有做出这个程序以及它的身份识别是否精准等问题。这些人的怀疑有点多余,其实我们根本不必为这样一款应用程序的出现感到惊讶。

早在两年前,媒体就对类似事件曾发出过警告。当时,Pornhub和xHamster这两大成人视频网站就开始应用人脸识别技术,自动给站内视频贴上标签、进行分类。他们把这一技术的应用称为“即将降临的隐私噩梦”。

除此之外,在俄罗斯,Findface这一类似程序也曾用于对性工作者和色情演员进行人肉搜索。该技术同样是通过将女性的面部特征与俄罗斯社交媒体平台VK上的个人资料匹配,从而进行识别。

所以说,这一技术的应用并不新奇,也非首创。

图片来源:unsplash.com/@joelb

图片来源:unsplash.com/@joelb

并非每个人都受到强有力的数据保护法的庇护

刚开始,Li Xu一直认为自己的行为并没有违法,因为他觉得自己并没有把这些数据公之于众,并且从事性工作在德国是合法的。色情产业在德国确实是合法的。但是,在未经同意的情况下,收集并处理他人的隐私数据(尤其是生物特征数据)绝对是违法的。

在现行的《通用数据保护条例》中,欧盟对准许处理个人数据的正当理由做出了多项规定。很明显,在这一事件中,个人数据的获取并没有取得对方的同意,所以更不存在任何合同义务或者公共利益。要想获得合法权益,似乎难上加难,因为在这一案例中,他们对女性进行人肉搜索的唯一目的,是让男人监控他们的女朋友或者妻子,看看她们有没有拍过淫秽视频。

照片是极其敏感的生物特征数据,通过使用特殊技术对照片进行处理,能够以此对真人进行识别或者认证。

对于欧盟国家的公民,以及其他数据保护机制较为完善的国家居民来说,这可能是一个好消息。但是真正的问题在于,那些淫秽视频的观看者与各大社交媒体平台的用户却来自于世界各地。到目前为止,世界上并不是每一个地区都有完备的数据保护法。即使有,若要将现存的法规执行下去也需要耗费大量的时间与财力。

此外在一些国家中,由于色情行业的合法性受到限制,或者存在许多不确定性,因此AV演员们也命途多舛,她们拍摄色情影片也常常遭到大众诟病与侮辱。并且在这些国家中,要么根本就没有相关的数据保护法;即使有,其法律效力也不足以用来保护此类特殊案例。

性别化监控的威胁越来越大

做这个程序的最终目的是识别出淫秽视频中的女性,并将她们公之于众,从而羞辱或者骚扰她们。根据推特上对于这一事件的翻译和报道,开发这款应用程序的初衷是让男人能检查他们的女朋友或者妻子,看看她们有没有出现在不雅视频中。

在大多数情况下,AV演员都会使用艺名,这对于那些非职业演员,以及那些需要将这一工作与她们的个人生活、家庭和其他事业分开的人尤为重要。然而,利用人脸识别技术来对AV女演员进行人肉搜索,这一行为不仅极具冒犯性,而且也严重侵犯了他人隐私。更严重的是,这种方式是对女性的监视。

其实,这一事件的发生并非个案。有针对性的网络骚扰也并没有止于Gamergate事件,此后也时有发生。这样的骚扰行径不仅会影响到女性,同时也会影响其他弱势群体在网络上自由表达的权利。

实际上,所谓的“跟踪软件”目前也正在市面上悄然兴起。在婚姻或者恋爱关系中,有暴力倾向的一方会直接或者间接购买这种软件,并且用它来秘密监控现任或者前任。

另一个与此类似的案例就是深度伪造技术,围绕这一技术的讨论也如火如荼。然而,目前该项技术的大部分研究和报道所关注的仍然是它的使用方法及其政治影响。诚然,这两方面确实很重要。然而我们更应该注意到的是,大部分人在利用深度伪造视频技术做什么。他们正在做的是利用该技术把女性的脸拼接到色情影片中,并以此来骚扰和羞辱她们。

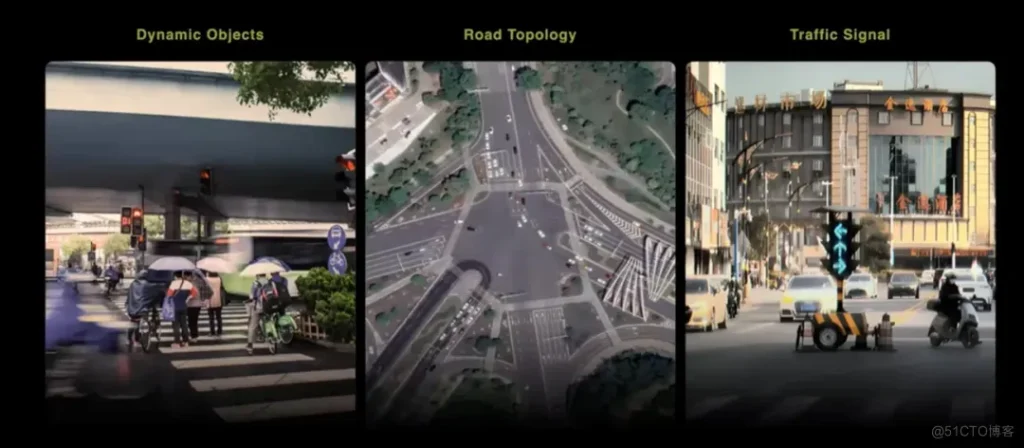

其实,早在现代的监控技术出现之前,女性就一直生活在男性甚至整个社会虎视眈眈的目光下。于是,女性的身体、一举一动,以及她们的参与权和自主权都受到了严密监控。近年来,相关学者也多次指出,随着大数据和机器学习技术的发展,带有性别歧视色彩的监控行为将会以更多的形式在社会上出现,其程度也会大大加深。

图片来源:unsplash.com/@tinaflour

图片来源:unsplash.com/@tinaflour

最后,使用类似算法“永远”不能解决问题

开发这一软件的程序员在意识到大众的强烈反对之后,立即补充道,女性们也可以使用这款应用程序来识别“复仇色情片”。可是,他现在才把这一想法说出来,真的是在为色情复仇中的受害者着想吗?不少人对此深表怀疑。的确,从技术层面上来讲,这一想法确实行得通。因为如果某个算法能够通过社交媒体来识别色情演员,那么它也就能找出那些遭到报复的女性,从一开始,这些女性出现在不雅视频中就并非出于自愿。

然而,在实际操作过程中,这一技术弊大于利。当然,要想找出复仇色情片不是什么大问题,真正的问题在于,受害者将会遭受哪些挣扎与伤痛。找到复仇色情片后,她们该如何把这些图像或视频从相关平台上撤下来;如果她们的家庭住址和电话号码被公开了,她们该如何保障自身安全,如何面对未来不断的骚扰行为,并且法律对此又不管不顾;最后,这样的事情发生后,她们又该如何面对自己的家人、朋友和同事。然而面对这些问题,人脸识别技术也毫无用武之地。

总而言之,如果要想防止被拍复仇色情视频,最好的预防手段就是保护好自己的数据和隐私,在分享穿着暴露的照片时一定要小心谨慎,通过安全的渠道分享。反正只要记住以上几点注意事项就足够了,没必要再浪费时间求助于人脸识别软件。

留言 点赞 发个朋友圈

我们一起分享AI学习与发展的干货

编译组:孙宇超、余书敏

相关链接:

https://towardsdatascience.com/facial-recognition-for-porn-is-still-a-terrible-idea-bb5dbb9c0281

如需转载,请后台留言,遵守转载规范

如有侵犯您的版权,请及时联系3500663466#qq.com(#换@),我们将第一时间删除本站数据。

暂无评论内容